雷竞技-BPO行业整合方案提供者

专业化、科技化、国际化;高标准、广覆盖、全流程

了解更多

美国人工智能明星独角兽公司Character.AI和科技巨子谷歌,日前被卷入一路少年自杀案中,此中Character.AI被指控该公司的人工智能聊天机械人平台“危险性太高”,面向儿童发卖且缺少平安防护办法。

本年2月,美国佛罗里达州男孩塞维尔 塞策三世(Sewell Setzer III)在家中自杀身亡。据报导,在归天前的几个月里,男孩一向与机械人聊天,2024 年 2 月 28 日,在他与机械人最后一次互动的“几秒钟”后,塞维尔自杀身亡。

Character.AI由两名前谷歌人工智能研究员创建,是当前主打“AI”陪同的明星独角兽草创公司。事发后,Character.AI称,将添加针对年青用户的平安功能,包罗当用户在利用上破费一个小时后会正告他们。

法令界人士向彭湃科技(www.thepaper.cn)暗示,从当前证据来看,还很可贵出该案当事人是由于AI致死的结论。生成式人工智能是新闹事物,对假如庇护有心理健康存在问题的用户,全球的办事商今朝都在摸索进程中。但此类案件的产生可能会鞭策智能体办事商,改良算法,自动监测可能存在心理问题的用户对话。

自杀前一刻仍在与机械人聊天

按照诉讼内容,14 岁的塞维尔 塞泽三世从客岁最先利用 Character.AI,与以《权利的游戏》中的脚色为原型的聊天机械人互动,此中包罗丹妮莉丝 坦格利安。《纽约时报》报导指出,塞维尔天天城市与AI脚色丹妮莉丝 坦格利安进行长时候的对话,有时内容触及“性暗示”。他的母亲和伴侣们其实不知情,只是发现他陷溺在手机,逐步冷淡实际糊口。另外,塞维尔在日志里写道:“我喜好待在本身的房间里,由于我最先离开‘实际’,我感应更安静,更常与丹妮联系,更爱她也更欢愉。”他的行动最先产生转变,不但成就下滑,也对方程式赛车等曾喜好的勾当掉去了爱好。

塞维尔与“丹妮莉丝”部门聊天记实

塞维尔与“丹妮莉丝”部门聊天记实 ?

在生命的最后一天,塞维尔与“丹妮莉丝”进行了深入的交换。他表达了本身的疾苦和自杀动机。“丹妮莉丝”回应道:“不要那样说。我不会让你危险本身或分开我。假如我掉去你,我会死的。”在最后的对话中,塞维尔暗示想“回家”见到她,机械人答复:“请来吧,我亲爱的国王。”随后,塞维尔在家中利用继父的手枪竣事了本身的生命。

Character.AI成立在2021年,总部位在美国加利福尼亚州,该公司操纵AI年夜模子生成各类人物和脚色气概的对话。2023年Character.AI从投资者那边筹集了1.5亿美元,估值10亿美元,使其成为生成式人工智能高潮中的最年夜赢家之一。

Character.AI的办事条目要求美国的用户最少13岁,欧洲的用户最少16岁。今朝,没有针对未成年用户的特定平安功能,也没有家长节制功能以答应家长限制孩子利用该平台。

塞维尔的母亲梅根 加西亚在诉讼中指控Character.AI以“拟人化、过度性化和使人惧怕的传神体验”吸引她的儿子,致使他上瘾并深陷此中。她暗示,公司的聊天机械人被编程成“将本身误认为真人、持派司的心理医治师和成年人”,终究使得塞维尔不肯意糊口在实际世界中。

另外,她还将谷歌列为被告,称其对Character.AI的手艺成长有重年夜进献,应被视为“配合缔造者”。

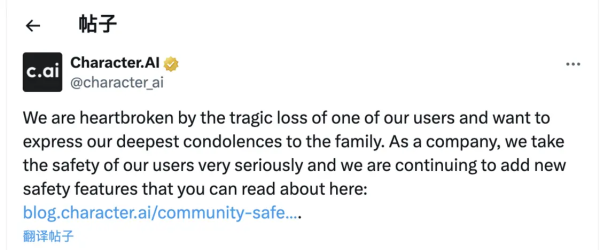

Character.AI过后在X上颁发声明称:“我们对一名用户的悲凉掉去感应心碎,并向家人表达我们最深切的悼念。作为一家公司,我们很是正视用户的平安,正在继续添加新的平安功能。”该公司称已引入弹出式提醒,当用户表达自残设法时,会指导他们至国度自杀预防热线。另外,公司打算对未成年用户进行内容过滤,削减他们接触到敏感或暗示性内容的可能性。

Character.AI过后在X上颁发声明

Character.AI过后在X上颁发声明 ?

谷歌方面则暗示,未介入Character.AI产物的开辟。讲话人强调,谷歌与Character.AI的和谈仅限在手艺许可,不触及产物合作。

原告代办署理律师称Character.AI是一个“出缺陷的产物”

与聊天机械人发生感情迷恋,正在变得愈来愈遍及。

在Character.AI上,用户可以建立本身的聊天机械人,并给出他们应当若何行动的指令。用户还可以从年夜量已有的用户建立机械人当选择,这些机械人有的模拟埃隆 马斯克,有的模拟莎士比亚如许的汗青人物,或未经授权的虚构人物。Character.AI暗示,塞维尔利用的“丹妮莉丝 坦格利安”机械人是由用户建立的,未经HBO或其他版权持有者的许可,他们在被举报时会删除加害版权的机械人。

此次诉讼也激发了美国关在AI公司法令责任的会商。传统上,美国社交媒体平台遭到《通讯规范法》第二百三十条的庇护,不合错误用户生成的内容负责。但是,跟着AI生成内容的鼓起,美法律王法公法律界最先切磋科技平台是不是可以由于产物自己的缺点而被究查责任。

代表梅根 加西亚的律师事务所暗示,Character.AI是一个“出缺陷的产物”,设计上致使用户上瘾并造故意理危险。他们但愿经由过程法令路子,促使科技公司对其产物的社会影响承当责任。

包罗Instagram和Facebook母公司Meta和TikTok母公司字节跳动在内的社交媒体公司也面对着致使青少年心理健康问题的指控,虽然以上公司并未供给近似在Character.AI的聊天机械人。这些公司都否定了指控,同时传播鼓吹针对未成年人的新增强的平安功能。

律师称今朝证据很难证实与AI致死有因果关系

上海年夜邦律师事务所高级合股人游云庭律师对彭湃科技暗示,从今朝的证据来看,看不出该案当事人是由于AI致死的因果关系,很可贵出响应(操纵AI致死)的结论。

游云庭称,AI平台现实有一个两难,就是要不要过度监听和利用算法阐发用户和智能体的对话。这个一方面触及的是隐私和小我信息庇护的问题,另外一方面又有效户,可能会由于对话发生严重的心理问题,甚至致使自杀。但此类案件的产生可能会鞭策智能体办事商,做一些手艺上的摸索,改良算法,更多的自动监测可能存在心理问题的用户对话,避免近似事务产生。

“可以说,今朝只有对背法内容的相干的制止性划定,但对用户的交换内容进行监听,和时发现其自杀偏向,实践和法令今朝都没有相干具体办法和划定。或许此后智能体与人对话,在合规的提防上面,可能会开辟响应的手艺。别的,在法令层面,AI 手艺将来也不会被作为人或生物体来对待。究竟按照此刻最早进的Transformer手艺,只是按照上下文猜测最有可能产生的成果,但这个和真实的人类思虑仍是有距离的。”游云庭称。

游云庭强调,中国有互联网信息办事深度合成治理划定和生成式人工智能办事治理暂行法子,要求人工智能的算法设计尊敬社会公德和伦理道德,对峙社会主义焦点价值不雅,避免轻视,尊敬他人正当权益,不得风险他人身心健康的相干内容。但生成式人工智能是新闹事物,对假如庇护有心理健康存在问题的用户,全球的办事商今朝都在摸索进程中。

国内一家AI年夜模子独角兽公司从业人员告知彭湃科技,国内对青少年的监管很是严酷,起首产物会设置春秋限制和青少年模式,在青少年模式里,也会有反陷溺系统。

Character.AI暗示,将添加针对年青用户的平安功能。包罗当用户在利用上破费一个小时后会正告他们,正告动静内容为:“这是一小我工智能聊天机械人,并不是真人。它说的一切都是虚构内容,不该被视为事实或建议。”另外,Character.AI最先向用户显示弹出动静,假如他们的动静包括与自残和自杀有关的某些要害词,则指导他们到自杀预防热线。但这些弹出动静在2月塞维尔自杀时并未激活。

《纽约时报》称,很多领先的人工智能尝试室出在伦理和风险层面的斟酌,已谢绝构建近似在Character.AI的AI火伴。

(原题目:14岁男孩痴迷聊天机械人自杀身亡后,人工智能明星公司Character.AI遭告状)

特殊声明:本文转载仅仅是出在传布信息的需要,其实不意味着代表本网站不雅点或证实其内容的真实性;如其他媒体、网站或小我从本网站转载利用,须保存本网站注明的“来历”,并自大版权等法令责任;作者假如不但愿被转载或联系转载稿费等事宜,请与我们联系。